Компания Apple официально подтвердила слухи о появлении в iOS, macOS и iMessage специального механизма, который будет выявлять на пользовательских устройствах изображения, потенциально содержащие элементы жестокого обращения с детьми.

Стоит отметить, что ранее Apple уже применяла подобные поисковые системы. В частности, они использовались для выявления фотографий, содержащих кадры жестокого обращения с детьми, отправляемых по электронной почте. Нечто похожее используют многие облачные и подобные сервисы.

Купертиновцы уверяют, что доступа к самим снимкам у них нет. Оценка производится на основе хэш-сумм. При этом в случае выявления совпадений, система проводит дополнительные проверки, после чего сформированные отчеты проходят «через руки» специалистов Apple. Таким образом, вероятность ложных срабатываний чрезвычайно низка.

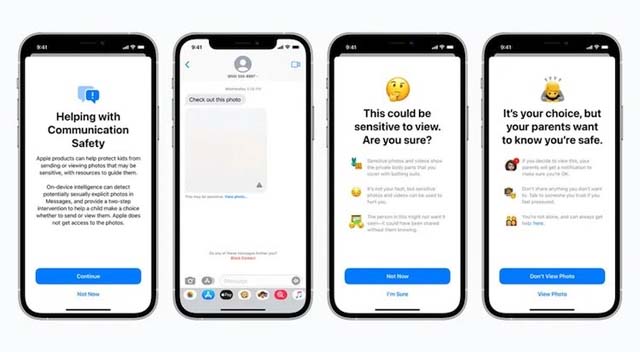

Наряду с новыми мерами в iCloud Photos, Apple добавила две дополнительные системы для защиты детей. Одна будет работать в Сообщениях и защищать детей от нежелательного контента. В случае если в переписке будут встречаться откровенные фотографии, система автоматически скроет их, а на экране появится предупреждение. Кроме этого родители получат уведомление, если ребенок получит или отправит откровенное изображение.

Другая система связана с Siri. Голосовой ассистент будет объяснять пользователям, что поиск контента, содержащего сцены жестокого обращения с детьми, может повлечь проблемы. Кроме этого ассистент сможет предоставить ссылки на ресурсы, которые предоставляют помощь в избавлении от нездоровых интересов.

Новые системы должны заработать осенью, но пока только в США.